Una perspectiva en el desarrollo de máquinas conscientes (o con mente, si equiparamos ambos conceptos) es construir artefactos con capacidad de representarse a sí mismos. A priori, podría parecer una perspectiva errónea ya que cuando somos conscientes de algo no necesariamente nos representamos a nosotros mismos. Si yo soy consciente del color rojo de una amapola, la amapola no forma parte de mí mismo. Consciencia y autorepresentación podrían no tener demasiado que ver. Sin embargo, no siendo demasiado quisquillosos, podríamos conceder que, aunque parezca empezar a construir la casa desde el tejado (ya que la autoconsciencia parece algo posterior a la consciencia), autoconsciencia sí que implica autorrepresentación. Si yo soy consciente del color de la piel de mi mano, estoy representando mi mano mentalmente. Quizá podamos descubrir algo por ahí.

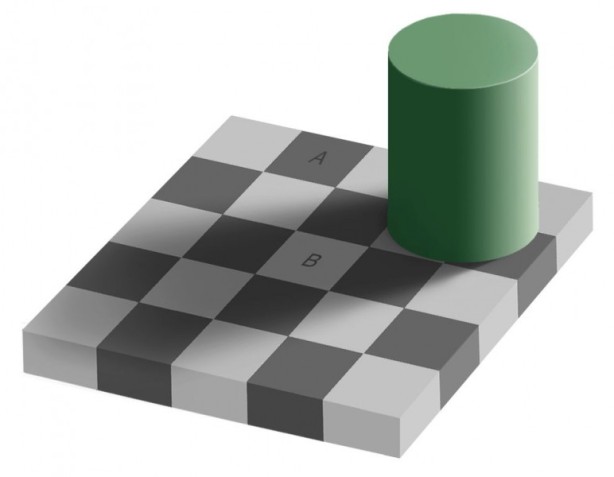

Un segundo problema está en establecer los límites del mí-mismo, es decir, encontrar la frontera entre lo que consideramos parte de nosotros mismos y lo que no. Si miramos la imagen de arriba (Transfer, de William Anastasi, 1968), observamos una videocámara que enfoca su fuente de alimentación y la muestra por el monitor. Si entendemos el conjunto cámara, monitor y cable de enchufe como un «individuo», tendríamos una cierta autorrepresentación. El monitor ofrece información del cable, una parte de nuestro individuo monitoriza otra parte (Aunque siendo puntillosos, verdaderamente no hay ninguna autorrepresentación, ya que los que ven la imagen del monitor son los observadores, y no la propia máquina). Empero, ¿con qué criterio definimos a este individuo como formado por monitor, cámara y cable de enchufe? ¿Por qué, por ejemplo, no le añadimos el enchufe de la pared o parte del cableado eléctrico que va por detrás del muro? También podríamos definir como dos individuos diferentes a la cámara y al monitor… ¿Qué es lo que hace de algo un ente individual? ¿Cuál es el principio de individuación?

Precisamente, una posible respuesta es la consciencia. Pensemos en nosotros mismos: ¿dónde está nuestra frontera? Yo sé, por ejemplo, que no soy el teclado del ordenador (aunque sea una propiedad mía, yo no soy lo que poseo), pero sí que hago mías mis manos ¿Por qué? Porque cuando me pinchan en ellas me duele, tengo consciencia de mi dolor. Así, todo mi cuerpo, en tanto que sujeto paciente de sensaciones, es un individuo. Y eso es lo que nos diferencia de los objetos: hemos definido la cámara, el monitor y el cable como un individuo porque nos ha dado la real gana, de una forma completamente convencional o arbitraria, ya que podríamos haber elegido cualquier otra configuración de elementos. Sin embargo, eso mismo no lo podemos hacer con una persona. No podemos decirle: tu cabeza, tu torso y tu brazo izquierdo forman parte de ti, pero tus dos piernas y tu brazo derecho no.

Entonces tenemos la clave: la parte de la máquina monitorizada por la propia máquina será el individuo. En el caso de la obra de Anastasi, podríamos decir que la zona en la que el cable está enchufado a la pared es el individuo, ya que esa esa la parte «sentida»; la parte en la que si ocurre algo, el resto de la máquina «se da cuenta», ya que se visualizará en la pantalla. No tan deprisa, nos hemos topado con el nudo gordiano: ¿qué quiere decir exactamente que la máquina sea capaz de sentir algo? Pues, lamentablemente, algo muy distinto a que el sistema tenga información de su entorno. Un micrófono no es consciente del sonido que recibe y una cámara tampoco es consciente de la luz que entra a través de sus lentes. Y es que tener información o conocimiento sobre algo no es lo mismo que ser consciente de algo. Yo, ahora mismo, no soy consciente de todo el conocimiento que tengo almacenado en mi cerebro. Yo puedo no ser consciente ahora mismo de la aseveración «Londres es la capital de Inglaterra», pero tengo ese conocimiento. Si alguien me preguntara cuál es la capital de Inglaterra yo haría consciente ese conocimiento en ese instante. El conocimiento puede ser consciente o inconsciente, mientras que la consciencia siempre alberga algún conocimiento. No puede existir una consciencia de nada (de aquí el concepto de intencionalidad de Brentano).

¿Y qué es lo que hace consciente la posesión de una determinada información? Esa es la pregunta millón amigos. No lo sabemos bien, pero aquí la tradición filosófica habla del tan famoso como misterioso concepto de yo, entendido, al menos, como un sujeto paciente (capaz de padecer) de sensaciones. El argumento central es: ¿sería posible la existencia de la sensación de dolor sin alguien que lo sufriera? ¿Es posible un dolor que no duela a nadie? No, toda percepción consciente va asociada a un yo, tiene un sujeto. Nuestra cámara-monitor, por mucho que pudiera tener una cierta autorrepresentación, no tiene yo, por lo que no tiene ninguna experiencia subjetiva. Ahora, el enigma está en comprender qué es ese rarísimo yo ¿Qué es ese ente capaz de percibir contenidos como sentidos, sufridos, padecidos?

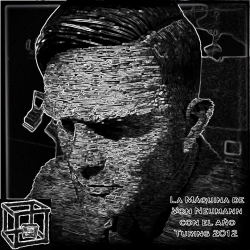

Entonces el gran problema que tenemos si queremos implementar consciencia en máquinas es que hay que construir yoes, y de momento, nadie tiene ni la más remota idea de cómo hacer algo así. Queridos amigos, los grandes modelos de lenguaje no son conscientes en absoluto, ni hay visos de que vayan a serlo en breve. En esto, la IA está tan verde como lo estaba en tiempos de Turing. Que no os vendan humo.