¿Para qué discutir? ¿Qué es lo que buscamos cuando arremetemos con nuestros argumentos contra cualquier desdichado habitante de la red? ¿La ególatra sensación de tener razón? ¿Alguien nos la ha dado alguna vez? ¿Alguna vez se la hemos dado a alguien? ¿Alguna vez hemos dicho: «Es verdad, me ha convencido, todo lo que he dicho hasta ahora son estupideces, tiene usted toda la razón»? ¿Nunca?

Es más, habitualmente utilizamos todo tipo de argucias para intentar vencer al otro. Argumentamos ad hoc, es decir, cuando nos atacan con un argumento fuerte hacemos todo lo posible por desbaratarlo y seguir manteniendo nuestra tesis de partida. Nunca nos paramos y decimos: «Pues es verdad, a lo mejor estoy equivocado. Nunca lo había visto de esa manera». Es más, incluso puede llegar el caso en que nos quedemos sin razones, en el que nuestro rival ha sido más hábil y no tenemos respuesta y, aún así, en vez de cambiar de opinión, sigamos en nuestras trece. He participado en varias discusiones en las que mi rival, después de una larga contienda en la que estaba siendo acorralado, respondía diciendo: «Bueno, esta es mi opinión, respétala». Hemos llegado al punto álgido del irracionalismo, nos hemos hecho inmunes a los razonamientos. Somos fundamentalistas, dogmáticos o fanáticos. Nos habremos convertido en este hincha del Real Madrid o del Barça, del PP o del PSOE, que siempre sostendrán con orgullo ciego que su equipo o su partido político son los mejores, con total indiferencia hacia los resultados deportivos o con el número de parlamentarios corruptos tras las siglas defendidas. ¿Qué sentido tiene algo así? ¿Por qué hacemos eso más que para satisfacer orgullos inconscientes o el deseo tribal de identidad o pertenencia a un grupo? ¿Qué saco yo cada vez que gano una contienda en Twitter? A lo sumo un poco de la diversión que otorga la esgrima dialéctica, el placer del deporte por el deporte mismo, pero nada más.

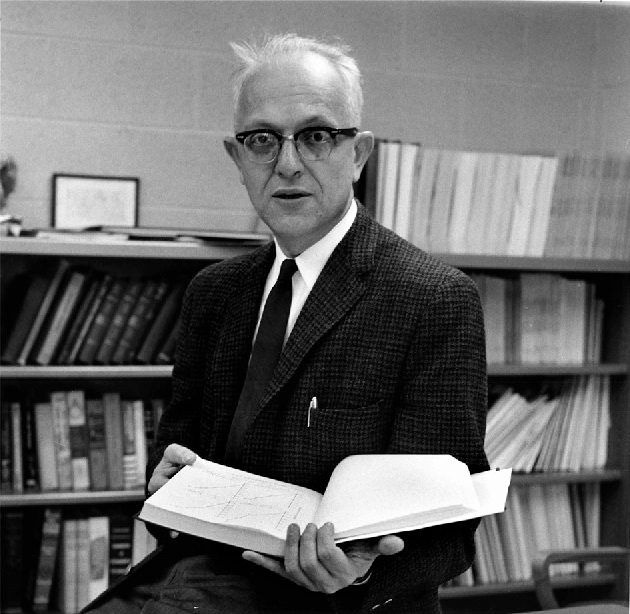

Por eso es mejor que cambiemos el propósito de la discusión: no hay que ganar sino aprender. El objetivo no será que mi rival me de la razón, sino que, entre los dos, lleguemos a algún punto. Es una tarea, muchas veces difícil, pues somos orgullosos y nos gusta ganar, pero hay que cambiar el chip. El recientemente fallecido Daniel Dennett, en su muy recomendable Bombas de Intuición, recoge las directrices que debes de seguir antes de comenzar un debate, propuestas por el psicólogo social Anatol Rapoport (el famoso creador de la estrategia toma y daca, ganadora del mítico torneo de dilema del prisionero organizado por Axelrod):

- Intenta expresar la posición blanco de tu crítica con tal claridad, viveza e imparcialidad que él mismo diga «Gracias, me gustaría haberlo expresado así».

- Haz una lista de todos sus puntos de acuerdo (especialmente si no se trata de acuerdos generales o extendidos).

- Menciona cualquier cosa que hayas aprendido del blanco de tu crítica.

- Solo cuando lo hayas hecho estarás autorizado para decir aunque sea una sola palabra para refutar o criticar.

Cuando se siguen estas reglas, un efecto inmediato es que los blancos de tus críticas se vuelven más receptivos a ellas: ya has mostrado que comprendes su postura tan bien como ellos, y también has demostrado tener buen juicio (coincides con ellos en algunos asuntos importantes e incluso algo que han dicho te ha convencido).

Yo reforzaría el punto 1, instándote a que busques razones para defender la posición de tu rival que incluso éste no haya tenido en cuenta. La idea es ponerte radicalmente en su piel, adoptar por completo su perspectiva, manejarla mejor que él ¡Quizá, hasta podría pasar que vieras que es mejor que la tuya!

En la misma línea, Dennett nos regala una curiosa anécdota. Cuenta que estaba asistiendo a un seminario en el MIT, impartido por Noam Chomsky y Jerry Fodor. En él, estos insignes pensadores estaban dando todo un show ante un divertido público, ridiculizando las ideas de Roger Schank. Dennett conocía muy bien la obra de Schank y no la reconocía, para nada, en las críticas de Chomsky. Vamos, que el célebre lingüista se estaba tirando un muñeco de paja a lo grande. Dennett levantó la mano y dijo que se estaban pasando por alto muchas de las sutilezas del pensamiento de Schank, a lo que Chomsky respondió que no, que, verdaderamente, Schank defendía las estupideces de las que le estaban acusando. Entonces, respondió Dennett, ¿por qué están perdiendo el tiempo criticando esa basura? La moraleja de esta historia es que hay que elegir bien el rival para así poder aprender de él. De nada sirve criticar una tesis absurda, sino que lo interesante es buscar las fisuras de una tesis sólida. Es por eso que nunca debato con terraplanistas, defensores del diseño inteligente, antivacunas, negacionistas del cambio climático, etc. ¿De qué me vale refutar idioteces? Lo interesante es refutar grandes propuestas. Para ilustrar más esto voy a terminar con una anécdota mía.

Tendría yo unos veintipocos años cuando di una breve ponencia en la Universidad Pontificia de Salamanca. Por aquel entonces estaba preparándome para opositar, era joven y pretencioso, e iba de ateillo rebelde postnietzscheano, pues eso parecía sonar muy cool en aquella cabecita loca. En unas Jornadas tituladas «Religión y Persona», rodeado de teólogos y pensadores cristianos, solté una diatriba contra la teología católica que ni el más furibundo barón D’Holbach. En la fase de ruegos y preguntas, todos cargaron contra mí, alguno incluso con malas formas. Yo me sentía genial, me creía Galileo luchando contra una banda de malvados belarminos. El caso es que un cura me preguntó que por qué había elegido algunas tesis de Tomás de Aquino como objeto de mis ataques, existiendo tanto pensador cristiano contra el que hacer blanco. Yo respondí que eso no era algo malo sino todo un halago: había elegido a Tomás de Aquino como diana porque, entre todos los teólogos cristianos, éste es al que más respetaba. Tomás de Aquino era un dignísimo rival del que aprender, no un enemigo al que ridiculizar. Curiosamente, en mi soberbia e ingenuidad veinteañera, tuve un resquicio de sabiduría.